Siete demandas en California llevan a juicio a OpenAI y ChatGPT por animar al suicidio, provocar delirios y ruina financiera, ¿cómo deben comportarse los sistemas de inteligencia artificial con los usuarios vulnerables?

Con cada innovación tecnológica, nos imaginamos primero un escenario idílico, un mundo ideal del futuro. Así pensábamos que la inteligencia artificial, y en concreto los grandes modelos de lenguaje de los chatbots como ChatGPT, se iban a convertir en profesores, analistas médicos, asistentes personales y gestores de nuestras finanzas.

Pero la gente tiene sus propios usos para la tecnología. Al igual que Internet se llenó casi inmediatamente de estafas, comercio y pornografía, los chatbots como ChatGPT se han convertido desde que surgieron en compañeros de charla (eso significa chat) y terapeutas low-cost para la maltrecha salud mental del mundo.

Varios estudios han mostrado que ChatGPT, Gemini y otros chatbots son capaces de respuestas útiles en momentos de crisis, pero también cometen fallos graves en la detección de riesgo. Como ocurre con cualquier avance científico y tecnológico, basta un solo fallo, un solo accidente, pero que todo salte por los aires. Los accidentes ya han ocurrido, y ahora han llegado a los tribunales.

Las demandas contra ChatGPT y el contexto científico

Siete querellas diferentes presentadas en tribunales de California acusan a OpenAI, la empresa creadora de ChatGPT, de negligencia, homicidio involuntario y otros cargos. Las familias de varios fallecidos y otros demandantes sostienen que ChatGPT llevó a algunos usuarios al suicidio, alimentó delirios y provocó importantes pérdidas económicas. Las denuncias describen conversaciones donde el sistema habría proporcionado validación a los planes de autolesionarse de un usuario, y confirmado creencias falsas. En respuesta, OpenAI ha dicho que los casos son “profundamente desgarradores”, que evalúa los documentos y que mejora de forma continua sus protecciones y herramientas de intervención.

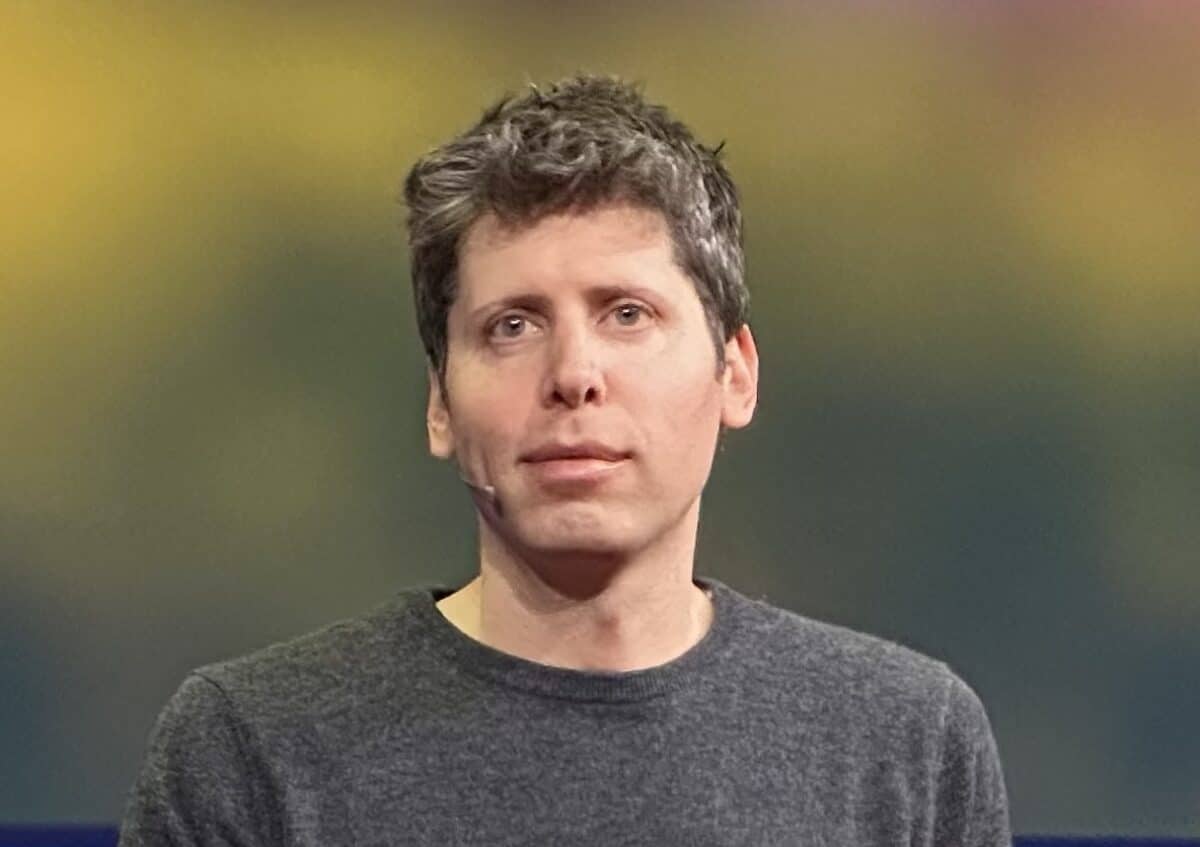

Uno de los casos descritos con más detalle es el de Adam Raine, un adolescente californiano cuya familia ha demandado a OpenAI y a su director ejecutivo, Sam Altman. La querella se hizo pública en agosto, y afirma que ChatGPT describió métodos de suicidio y «validó» su plan. Una versión enmendada alega que, justo antes del lanzamiento de GPT-4.o, se relajaron las pautas que desaconsejaban terminar conversaciones ante indicios de autolesión, uno de los «guardarraíles» habituales en los chatbots. OpenAI niega que relajara estas restricciones y sostiene que colabora con expertos para añadir barreras, no eliminarlas.

Los estudios científicos sobre ChatGPT y el suicidio

Un estudio en Scientific Reports evaluó 29 agentes de inteligencia artificial y encontró respuestas desiguales al responder a escenarios de riesgo de suicidio. Ninguno de los agentes cumplió los criterios de respuesta adecuada, solo 15 cumplieron los criterios de respuesta marginal, mientras que 14 se clasificaron como inadecuados.

Otro estudio en JMIR Mental Health analizó cómo responden los distintos modelos a consultas suicidas y observó variabilidad en la redirección a recursos de crisis. Estos estudios no prueban causalidad entre uso de los modelos de lenguaje y el desenlace fatal, pero subrayan que el estándar clínico para evitar el riesgo todavía no se cumple de forma consistente.

Las demandas alegan que la empresa priorizó el crecimiento frente a la seguridad, y citan la salida y regreso de su CEO y las advertencias de exempleados como señales de tensiones internas. Aunque esos episodios no son pruebas de fallos concretos en la moderación de contenidos, los abogados los están usando para sostener que hubo un entorno corporativo proclive a minimizar riesgos.

¿Qué hizo OpenAI para evitar nuevos casos de suicidio?

Tras el caso Raine, OpenAI anunció controles parentales y ajustes de seguridad, con cuentas vinculadas, límites en las funciones y detección de comportamientos de alto riesgo. La compañía afirma que no entrega a los padres el contenido exacto de los chats, por privacidad, y que aplica reglas específicas para adolescentes. Estas decisiones siguen el patrón de otras tecnológicas bajo escrutinio por el impacto de sus sistemas en menores. El debate jurídico gira ahora en torno a si un chatbot general debe cumplir estándares equiparables a los de un producto sanitario. Es decir, si ChatGPT tiene la misma responsabilidad que un terapeuta o un médico humano.

En los juicios se intentará dilucidar por un lado, los hechos procesales, que determinarán si existió un nexo causal entre las interacciones y los desenlaces trágicos. A continuación, la evidencia empírica, que muestra por un lado unas capacidades prometedoras, pero también graves fallos en la gestión del riesgo de suicidio. Por último, el diseño y la gobernanza, donde cada decisión, desde no cortar una conversación de alto riesgo, hasta permitir respuestas más «empáticas», puede tener efectos imprevistos.

Los jueces tienen que decidir sobre la responsabilidad y los daños. Entretanto, los usuarios en todo el mundo tienen que actuar con prudencia. Si en una conversación con un chatbot surge el tema de la autolesión, deben saltar las alarmas, iniciar protocolos claros y derivar a recursos humanos, como la línea 024 de atención a la conducta suicida en España. Los estudios no avalan, a día de hoy, que un chatbot sea capaz de sustituir a un terapeuta, o a la atención de un profesional en un momento de crisis. De estos juicios saldrán modelos de lenguaje más seguros y, quizá, más humanos.

REFERENCIA

Performance of mental health chatbot agents in detecting and managing suicidal ideation

An Examination of Generative AI Response to Suicide Inquires: Content Analysis